Yapay Zeka İçin Yüksek Performans PCIe GPU Kartları

RTX PRO 6000 Blackwell, H200 NVL, H100 PCIe ve L40S gibi ileri seviye PCIe GPU kartlar

NVIDIA’nın PCIe tabanlı GPU çözümleri, farklı soğutma türleri ve kullanım senaryolarıyla hem veri merkezi altyapıları hem de yüksek performanslı iş istasyonları için tasarlanmış geniş bir ürün yelpazesi sunar.

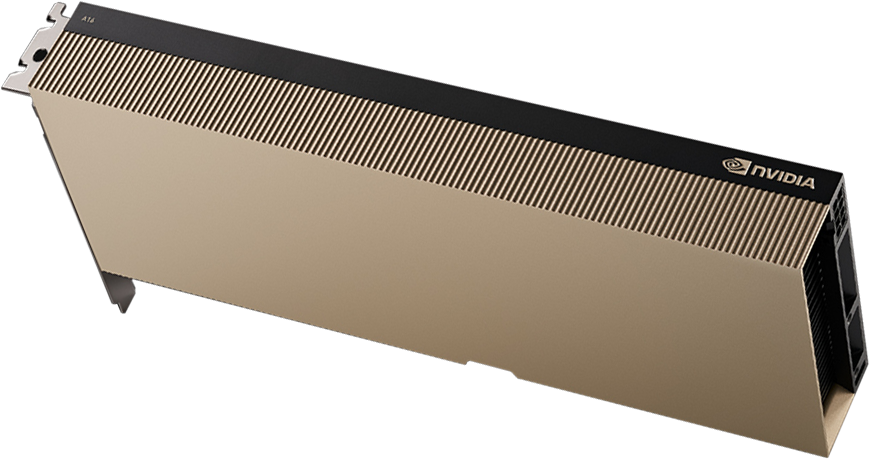

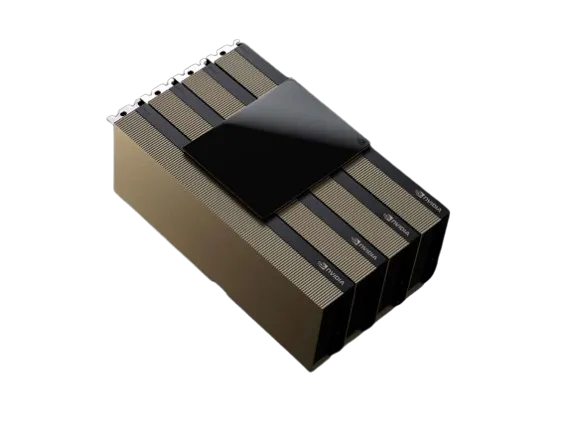

NVIDIA H200 NVL 141GB / 564GB HBM3e PCIe 5.0 Veri Merkezi GPU'su

NVIDIA H200 NVL, 141GB HBM3e belleği ve PCIe 5.0 veri yolu ile büyük dil modelleri (LLM), yapay zeka eğitimi ve çıkarım süreçleri için olağanüstü performans sunar. Bellek bant genişliği, bellek kapasitesi ve enerji verimliliğiyle veri merkezleri için optimize edilmiştir.

Nvidia H200 NVL GPU, 4 adede kadar NVLink ile birbirine bağlanabilir. Toplamda 564 GB HBM3e belleğe ve son derece yüksek bant genişliğine sahip birleşik bir GPU kümesi oluşturur. Bu konfigürasyon, özellikle büyük yapay zeka modellerinin eğitimi, çıkarımı (inference) ve yüksek bant genişliği gerektiren veri merkezli uygulamalar için tasarlanmıştır.

NVIDIA H100 NVL 94GB / 188GB HBM3 PCIe 4.0 Veri Merkezi GPU'su

NVIDIA H100 NVL 94GB, büyük dil modelleri (LLM) için tasarlanmış, olağanüstü bellek kapasitesi ve yüksek bant genişliği sunan, inference odaklı üst seviye yapay zeka GPU kartıdır. Hopper mimarisi üzerine inşa edilen bu çift kartlı yapı, toplamda 188 GB HBM3 belleğiyle, devasa modelleri gerçek zamanlı çalıştırmak için mükemmel bir altyapı sunar.

Çift H100 GPU arasındaki NVLink bağlantısı sayesinde 600 GB/sn'ye varan ultra hızlı veri aktarımı sağlanır. Bu yapı, özellikle ChatGPT, LLaMA, Mistral, Claude, Falcon gibi büyük transformer tabanlı modellerin düşük gecikmeyle, çoklu oturumda, aynı anda sunulmasına olanak tanır.

H100 NVL, NVIDIA'nın TensorRT-LLM ve Triton Inference Server yazılımlarıyla tam uyumlu çalışır. Aynı zamanda vLLM gibi açık kaynak inference framework’leriyle optimize edilmiş performans sunar.

Yapay zeka servis sağlayıcıları, inference-as-a-service altyapısı sunan şirketler ve yüksek yoğunluklu LLM uygulamaları geliştiren kurumlar için H100 NVL, mutlak tercih haline gelmiştir.

NVIDIA RTX PRO 6000 Server Edition - Passive 96GB PCIe 5.0 Veri Merkezi GPU'su

Veri Merkezi için Evrensel Yapay Zeka ve Görsel Hesaplama Performansı

Çığır açan NVIDIA Blackwell mimarisi üzerine inşa edilen NVIDIA RTX PRO™ 6000 Blackwell Server Edition, kurumsal veri merkezi iş yüklerini hızlandırmak için güçlü bir AI ve görsel bilgi işlem yetenekleri kombinasyonu sunar. 96 GB ultra hızlı GDDR7 bellekle donatılan NVIDIA RTX PRO 6000 Blackwell, aracı AI, fiziksel AI ve bilimsel bilgi işlemden işleme, 3D grafikler ve videoya kadar çok çeşitli kullanım durumlarını hızlandırmak için benzersiz performans ve esneklik sağlar.

NVIDIA L40S 48GB HBM3 PCIe 4.0 Veri Merkezi GPU'su

NVIDIA L40S, yapay zeka çıkarım (inference), generative AI, 3D grafik işleme ve sanallaştırılmış iş istasyonları (vGPU) için optimize edilmiş, kurumsal sınıf bir PCIe GPU kartıdır. Ada Lovelace mimarisi üzerine inşa edilen L40S, 48GB GDDR6 belleği, 18.1 TFLOPS FP32 işlem gücü ve 91.6 TFLOPS Tensor performansı ile çok yönlü iş yükleri için ideal bir çözümdür.

L40S, RTX 6000 Ada ile aynı mimariyi paylaşmasına rağmen, AI inference ve gerçek zamanlı render senaryolarında daha agresif güç profili ve CUDA çekirdek dağılımı ile öne çıkar. Özellikle görsel üretim (rendering), dijital içerik oluşturma (DCC), yapay zeka destekli görsel analiz ve medya tabanlı LLM uygulamalarında yüksek verimlilik sağlar.

vGPU desteği ile sanallaştırılmış ortamlarda da güçlü bir performans sunan L40S, hem masaüstü iş istasyonlarında hem de veri merkezi sınıfı sunucularda güvenle kullanılabilir.

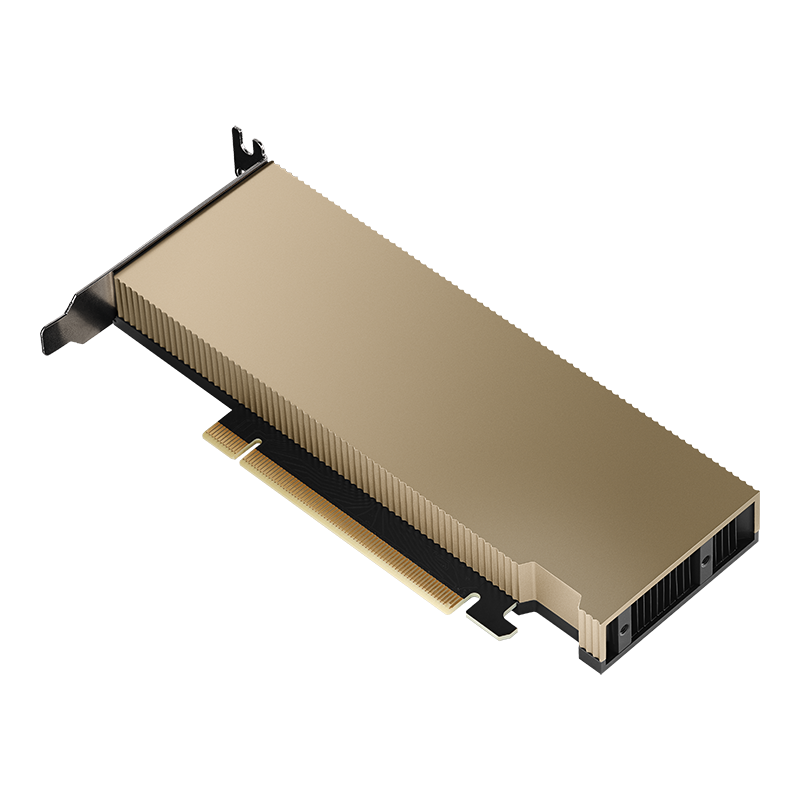

NVIDIA A16 PCIe GPU - 64 GB GDDR6 Veri Merkezi GPU'su

Sanal Masaüstü Altyapıları (VDI) için Optimize Edilmiş Yüksek Yoğunluklu Grafik Performansı

NVIDIA A16 GPU, sanallaştırılmış masaüstü altyapıları (VDI) için özel olarak tasarlanmış, yüksek kullanıcı yoğunluğu ve üstün grafik performansı sunan bir çözümdür. NVIDIA'nın Ampere mimarisi üzerine inşa edilen A16, dört adet GA107 GPU çekirdeğini tek bir kartta birleştirerek, uzaktan çalışma ve sanal masaüstü uygulamalarında kullanıcı deneyimini üst seviyeye taşır.

NVIDIA L4 PCIe GPU – 24 GB GDDR6 Kompakt EDGE AI GPU'su

Enerji Verimliliği ve Yüksek Performansı Bir Arada Sunan Evrensel Hızlandırıcı

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen L4 Tensor Core GPU, video işleme, yapay zeka çıkarımı ve grafik uygulamaları için enerji verimli ve yüksek performanslı bir çözüm sunar. 24 GB GDDR6 belleği ve 300 GB/s bellek bant genişliği ile L4, düşük güç tüketimiyle (72W TDP) yüksek verimlilik sağlar. Yapay zeka çıkarımı, video işleme ve sanal masaüstü altyapıları gibi çeşitli iş yükleri için idealdir.

NVIDIA A2 PCIe GPU – 16 GB GDDR6 Kompakt EDGE AI GPU'su

Kompakt Tasarımda Yüksek Verimli Yapay Zeka Çıkarımı

NVIDIA A2 Tensor Core GPU, düşük güç tüketimi ve küçük form faktörüyle giriş seviyesi yapay zeka çıkarımı için ideal bir çözümdür. 16 GB GDDR6 belleği ve 200 GB/s bellek bant genişliği ile A2, enerji verimliliği ve performansı bir arada sunar. 40-60W arasında yapılandırılabilir TDP değeri sayesinde, termal kısıtlamaları olan sistemlerde bile etkili bir şekilde çalışabilir.

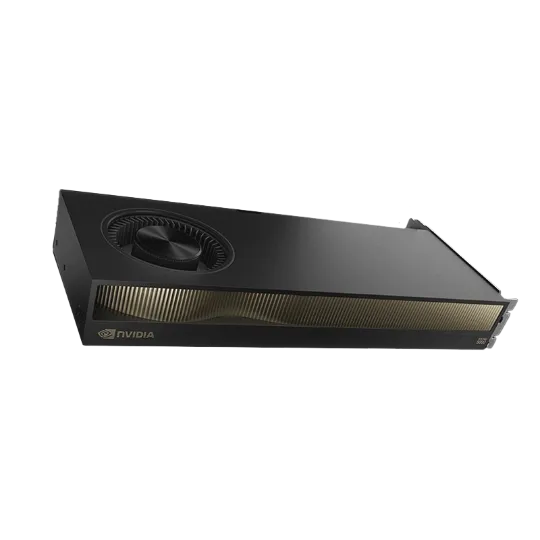

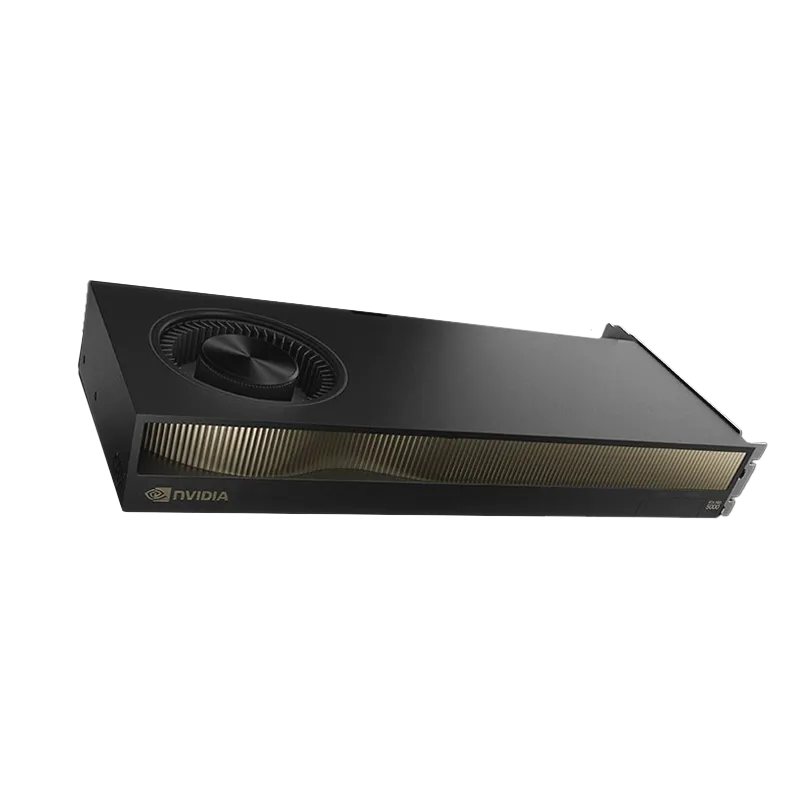

NVIDIA RTX PRO 6000 Blackwell Workstation Edition – 96 GB GDDR7 / MIG Support

Yapay Zeka ve Profesyonel İş Akışları İçin Üstün Performans

NVIDIA'nın en güçlü masaüstü GPU'su olan RTX PRO 6000 Blackwell Workstation Edition, 96 GB GDDR7 belleği ve 24.064 CUDA çekirdeği ile yapay zeka, veri bilimi, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 600W TDP değeri ve çift akışlı soğutma sistemi ile yüksek performansı sürdürülebilir kılar.

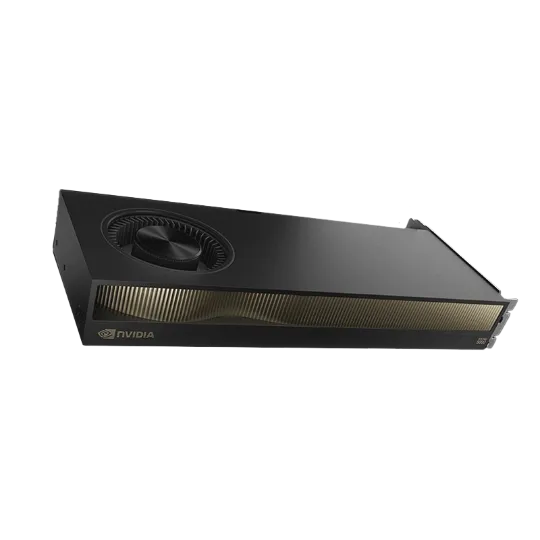

NVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Edition - 96GB 300W / MIG Support

Yüksek Performanslı, Enerji Verimli ve Ölçeklenebilir Profesyonel GPU Çözümü

NVIDIA'nın Blackwell mimarisi üzerine inşa edilen RTX PRO 6000 Blackwell Max-Q Workstation Edition, 96 GB GDDR7 ECC belleği ve 24.064 CUDA çekirdeği ile yapay zeka, veri bilimi, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 300W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. MIG (Multi-Instance GPU) desteği sayesinde, birden fazla kullanıcıya veya uygulamaya ayrılmış GPU kaynakları sunarak esnek ve verimli kullanım sağlar

Nvidia A800 40GB Active GPU / 2way NVlink

Yapay Zeka ve Profesyonel İş Akışları İçin Üstün Performans

NVIDIA A800 40GB Active, yüksek performanslı yapay zeka (AI), veri bilimi ve yüksek performanslı hesaplama (HPC) uygulamaları için tasarlanmış profesyonel bir GPU'dur. NVIDIA'nın Ampere mimarisi üzerine inşa edilen bu kart, özellikle NVLink desteğiyle çift GPU yapılandırmalarında üstün performans ve ölçeklenebilirlik sunar.

NVIDIA RTX PRO 5000 Blackwell Workstation Edition – 48 GB GDDR7 ECC / MIG Support

Yüksek Performanslı, Enerji Verimli ve Ölçeklenebilir Profesyonel GPU Çözümü

NVIDIA'nın Blackwell mimarisi üzerine inşa edilen RTX PRO 5000 Blackwell Workstation Edition, 48 GB GDDR7 ECC belleği ve 14.080 CUDA çekirdeği ile yapay zeka, veri bilimi, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 300W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. MIG (Multi-Instance GPU) desteği sayesinde, birden fazla kullanıcıya veya uygulamaya ayrılmış GPU kaynakları sunarak esnek ve verimli kullanım sağlar.

NVIDIA RTX 4500 Ada Generation – 24 GB GDDR6 ECC

Profesyonel İş Akışları İçin Yüksek Performans ve Enerji Verimliliği

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 4500 Ada Generation, 24 GB GDDR6 ECC belleği ve 7.680 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 210W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. MIG (Multi-Instance GPU) desteği sayesinde, birden fazla kullanıcıya veya uygulamaya ayrılmış GPU kaynakları sunarak esnek ve verimli kullanım sağlar.

NVIDIA RTX 4000 Ada Generation – 20 GB GDDR6 ECC

Tek Yuvalı Tasarımda Üstün Performans ve Enerji Verimliliği

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 4000 Ada Generation, 20 GB GDDR6 ECC belleği ve 6.144 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 130W TDP değeri ve tek yuvalı blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. MIG (Multi-Instance GPU) desteği sayesinde, birden fazla kullanıcıya veya uygulamaya ayrılmış GPU kaynakları sunarak esnek ve verimli kullanım sağlar.

NVIDIA RTX 5880 Ada Generation – 48 GB GDDR6 ECC

Yüksek Bellek Kapasitesi ve Enerji Verimliliğiyle Profesyonel İş Akışları İçin Üstün Performans

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 5880 Ada Generation, 48 GB GDDR6 ECC belleği ve 14.080 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 285W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. MIG (Multi-Instance GPU) desteği sayesinde, birden fazla kullanıcıya veya uygulamaya ayrılmış GPU kaynakları sunarak esnek ve verimli kullanım sağlar.

PNY NVIDIA RTX 6000 Ada Generation 48GB

Profesyonel İş Akışları İçin Üstün Performans ve Güvenilirlik

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 6000 Ada Generation, 48 GB GDDR6 ECC belleği ve 18.176 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 300W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar.

NVIDIA RTX 5000 Ada Generation 32GB

Profesyonel İş Akışları İçin Yüksek Performans ve Güvenilirlik

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 5000 Ada Generation, 32 GB GDDR6 ECC belleği ve 12.800 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 400 dördüncü nesil Tensor Çekirdeği ve 100 üçüncü nesil RT Çekirdeği ile AI ve ışın izleme performansını üst seviyeye taşır. Çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar.

NVIDIA RTX 4000 SFF Ada Generation – 20 GB GDDR6 ECC

Kompakt Form Faktöründe Yüksek Performanslı Profesyonel GPU Çözümü

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 4000 SFF Ada Generation, 20 GB GDDR6 ECC belleği ve 6.144 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 70W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. Kompakt boyutları sayesinde küçük form faktörlü sistemlerde bile üstün performans sağlar.

NVIDIA RTX 2000 Ada Generation – 16 GB GDDR6 ECC

Kompakt Tasarımda Yüksek Performanslı Profesyonel GPU Çözümü

NVIDIA'nın Ada Lovelace mimarisi üzerine inşa edilen RTX 2000 Ada Generation, 16 GB GDDR6 ECC belleği ve 2.816 CUDA çekirdeği ile yapay zeka, grafik tasarımı ve mühendislik simülasyonları gibi yoğun iş yükleri için tasarlanmıştır. 70W TDP değeri ve çift slotlu blower tipi aktif soğutma sistemi ile yüksek performansı sürdürülebilir kılar. Kompakt boyutları sayesinde küçük form faktörlü sistemlerde bile üstün performans sağlar.

YAPAY ZEKA PROJELERİNİZDE MAKSİMUM PERFORMANSI YAKALAYIN..

Yapay zeka uygulamalarınız için optimize edilmiş GPU sunucu çözümlerimizle tanışın; NVIDIA PCIe GPU'ları ile donatılmış yüksek hızlı, güvenilir ve ölçeklenebilir çözümlere sahip olun..

tarafından geliştirilmiştir.

tarafından geliştirilmiştir.